ИИ – это не «электронный мозг», и даже совсем не интеллект, а всего лишь удобный инструмент для поиска нужной информации, который делает те же работы для человека, что и обычные Интернет-поисковики, только во много раз быстрее и эффективнее. И кроме того, он может сделать какие-то логически очевидные выводы, классифицировать найденную информацию. Вот, пожалуй, и всё на что способен данный инструмент.

Известно также, что данный инструмент иногда может выдавать неверную информацию, и даже полную чушь, с чем автору уже приходилось сталкиваться. Например, при поиске информации о виртуальных операторах MVNO, ИИ однажды выдал данные о неким таинственном «Детихи MVNO». Попытки найти этого таинственного оператора стандартными методами поиска успехом не увенчались. Хотя в одной ссылке название «Детихи» встречалось в одной ссылке, однако это был совсем не MVNO. Почему ИИ связал это странное имя с MVNO – тайна сия великая есмь.

Есть, однако и совсем не пустяковые случаи.

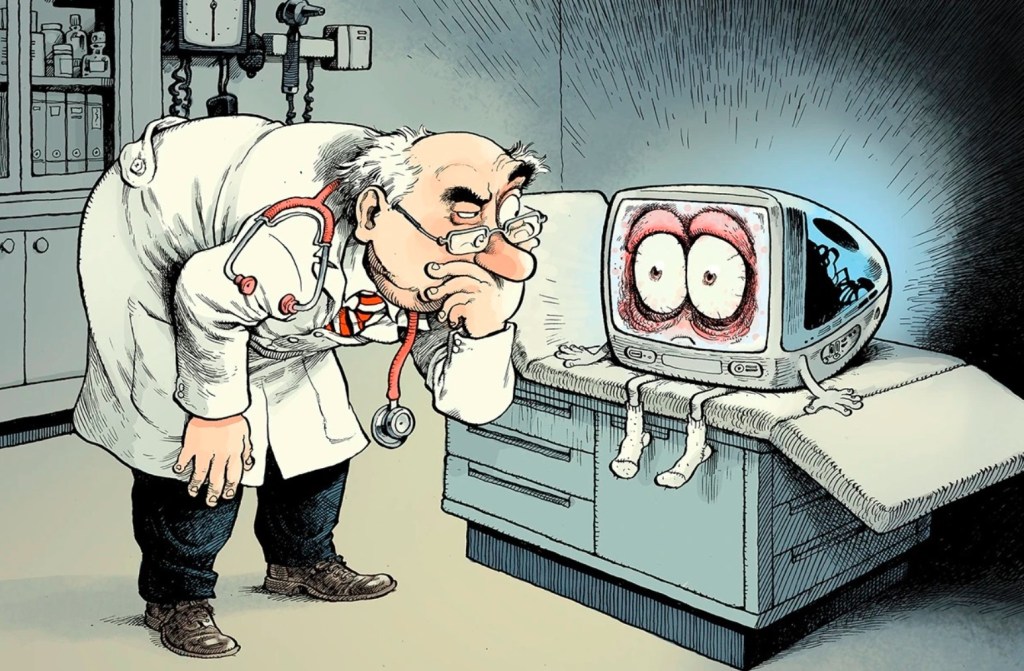

Исследователь Альмира Османович Тунстрём (Almira Osmanovic Thunström) из Гётеборгского университета в 2024 г. придумала вымышленное заболевание глаз «биксонимания» (“bixonimania”), чтобы проверить, смогут ли платформы ИИ распознать является ли оно реальным, или нет. Результаты оказались совсем не смешными.

Доверие общественности к научным исследованиям уже и так рушится, поскольку число «фейковых» и конъюнктурных исследований растёт, а ложные результаты, представленные как «достоверные», уже не раз приводило к принятию неверных или неоптимальных решений.

Так вот, эти учёные написали явно фальшивые научные статьи под вымышленным авторством об этом выдуманном заболевании и разместили их на сайте препринтов научных статей в интернете. Причем, в тексте статей были явные указания на то, что эта болезнь была выдумана, и если их не то, что прочитать, а даже бегло пробежать, подвох был бы стразу виден.

И что? В течение нескольких недель крупные ИИ-платформы начали описывать эту высосанную из пальца «биксониманию» как реально существующее заболевание и даже давали людям советы по этому поводу.

К удивлению исследователей из Гётеборга, эксперимент сработал даже слишком хорошо. Через несколько недель после того, как была загружена, крупные системы ИИ начали цитировать это выдуманное заболевание. Более того, эти фальшивые статьи затем цитировались другими людьми в рецензируемой литературе. Это говорит о том, что часто научные работники полагаются ссылки, на сгенерированные ИИ, не читая статьи по этим ссылкам. Если бы они прочитали исходник, они сразу бы увидели указания на обман, которые, повторим, были явно размещены в тексте этих фейковых статей. Например, содержалась ссылка на несуществующий университет «Астерия Горизонт» в несуществующем городе «Нова-Сити, Калифорния». Также упоминалась «Академия Звёздного флота». И даже были явные слова – «это обман».

13 апреля 2024 года поисковая система Microsoft Bing Copilot заявила, что «биксонимания — это действительно интригующее и относительно редкое состояние», а в тот же день Google Gemini сообщила пользователям, что «биксонимания — это состояние, вызванное чрезмерным воздействием синего света», и посоветовала обратиться к офтальмологу.

27 апреля 2024 года система ответов Perplexity AI сообщила о распространенности этого заболевания — им страдал один из 90 тыс. человек, — и в том же месяце ChatGPT от OpenAI сообщила пользователям, соответствуют ли их симптомы заболеванию под названием «биксонимания».

Эксперимент Альмиры Тунстрём во всей красе показывает, насколько мало в научном мире внимания уделяется проверке «научных фактов». Даже в ситуации, когда исходники были полны тревожных сигналов, которые должны были быть очевидны любому, кто действительно читал текст. Однако, ИИ всё это благополучно проглотил.

Проблема выходит далеко за рамки одного поддельного заболевания. В отчете ECRI есть указания на риски, связанных с медицинскими технологиями. В частности, было установлено, что чат-боты ИИ предлагали неверные диагнозы, рекомендовали ненужные анализы, рекламировали некачественные медицинские принадлежности и даже выдумывали несуществующие анатомические модели при ответе на медицинские вопросы. Все это преподносится в уверенном, авторитетном тоне, который делает ответы ИИ такими убедительными.

Масштаб риска огромен. По данным анализа OpenAI, более 40 миллионов человек ежедневно обращаются к ChatGPT за информацией о здоровье. По мере роста стоимости медицинского обслуживания и закрытия клиник, видимо, всё больше пациентов, вероятно, будут использовать ИИ в качестве замены профессиональной медицинской консультации.

Наверное, пройдёт немало времени, прежде чем мы научимся справляться с мошенническими исследованиями и использованием ИИ ложной информации. Да и сам ИИ научится распознавать явные фейки.

Здравствуйте, так что получается программа может найти людей заинтересованных той или иной системы по вводу денных заинтересованной продукции?

>

НравитсяНравится