Вводное замечание. Следует иметь в виду, что русский термин «искусственный интеллект» — это не совсем точный перевод английского термина Artificial Intelligence (AI). Для слова «Интелект» в английском языке имеется более точный аналог — «Intellect». Слово Intelligence имеет значение как «ум», «ловкость», «сообразительность», и даже — «разведка». Например Центральное Разведывательное Управление США (ЦРУ) по английски называется Central Intelligence Service (CIA).

1940-е

- В статье «Логическое исчисление идей, присущих нервной деятельности» (A logical calculus of ideas immanent in nervous activity) опубликованой Уолтером Питтсом (Walter Pitts) и Уорреном Маккалоком (Warren McCalloch) (https://www.cs.cmu.edu/~./epxing/Class/10715/reading/McCulloch.and.Pitts.pdf), впервые обсуждаются математические модели нейронных сетей.

1950-е

- Термин «машинное обучение» (Machine Learning) впервые был использован Артуром Сэмюэлом (Arthur Samuel). Он написал программу для игры в шашки на компьютере, которая играла на уровне мастеров с возможностью дообучения в процессе игры.

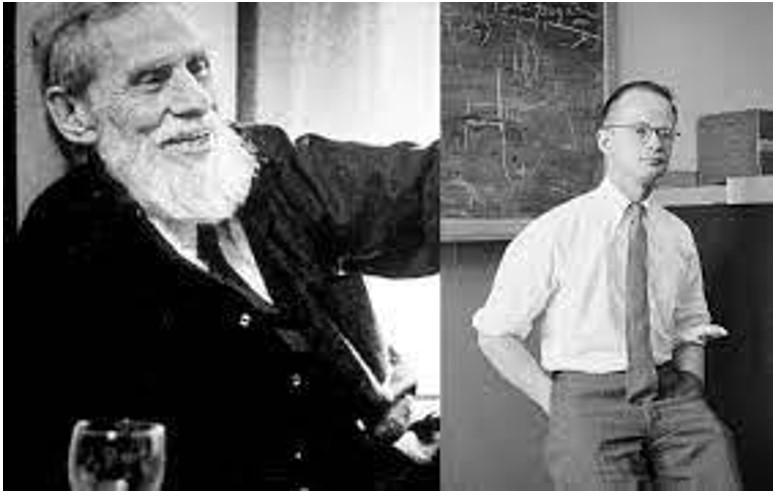

- В 1951 г. Марвин Мински (Marvin Minsky) и Дин Эдмондс (Dean Edmonds) разработали первую искусственную нейронную сеть из 40 нейронов. Эта сеть имела возможности как кратковременной, так и долговременной памяти.

- На семинаре в Дармуте (Darmouth Workshop) в 1956 г., длившемся два месяца, были впервые представлены результаты исследований по искусственному интеллекту AI (Artificial Intelligence) и машинному обучению ML (Machine Learning).

1960-е

- В 1960 г. советские учёные в области автоматического управления, кибернетики и математического моделирования Алексей Григорьевич Ивахненко и Валентин Григорьевич Лапа представили иерархическое представление нейронной сети. А.Г. Ивахненко считается отцом-основателем глубокого обучения (Deep Learning) нейросетей.

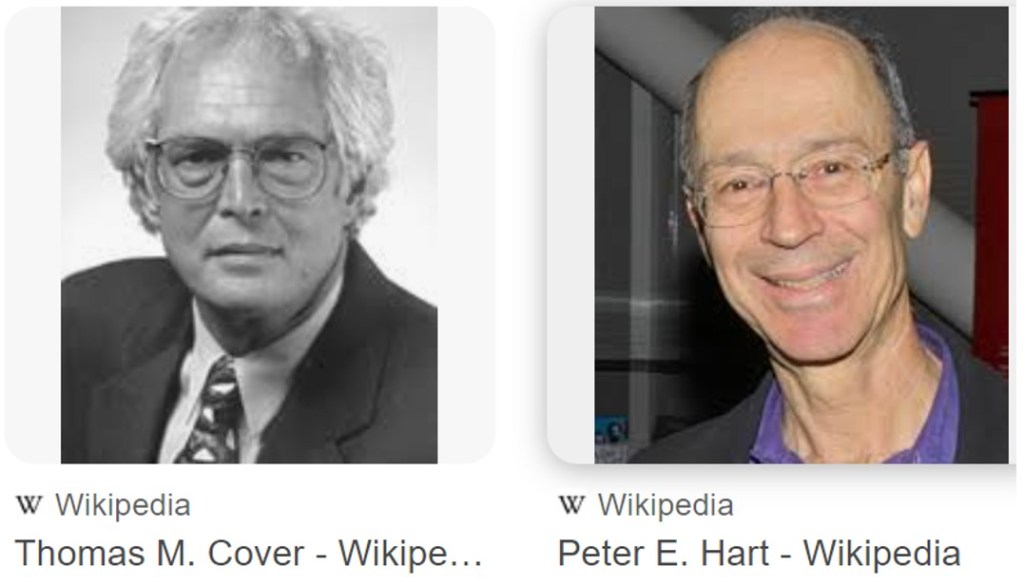

- В 1967 г. учёные из Университета Стэнфорда (Калифорния) Томас Кавер (Thomas Cover) и Питер Харт Peter E. Hart опубликовали статью об «алгоритме ближайших соседей» (Nearest Neighbor Pattern Classification) (https://isl.stanford.edu/~cover/papers/transIT/0021cove.pdf). Эти алгоритмы в настоящее время используются для решения регрессивных и классификационных задач в машинном обучении.

- В 1960-80-х годах под эгидой Университета Стэнфорда проводился проект «интеллектуального робота-тележки» Stanford Cart (https://news.stanford.edu/stories/2019/01/stanfords-robotics-legacy), целью которого была автономная навигация робота в трехмерной пространстве.

1970-е

- В 1979 г. японский учёный-компьютерщик Кунихико Фукушима (Kunihiko Fukushima) опубликовал работу по распознаванию образов (pattern recognition), с использованием многослойных иерархических нейронных сетей (https://search.ieice.org/bin/summary.php?id=j62-a_10_658). Эта работа проложила путь к разработке конволюционных нейросетей (convolutional neural network).

1980-е

- В 1985 г. учёный из Университета Хопкинса (The Johns Hopkins University), Терренс Сейновски (Terrence Sejnowski) и Чарльз Розенберг (Charles Rosenberg) из Принстонского Университета изобрели нейронную сеть под названием NETtalk (https://content.wolfram.com/sites/13/2018/02/01-1-10.pdf), которая могла обучать правильному произношению английских текстов, включая не находящиеся во входном словаре.

- В 1986 г. учёный из Университета Хопкинса (The Johns Hopkins University), Пол Смоленски (Paul Smolensky) изобрел ограниченную машину Harmonium RBM (Restricted Boltzmann Machine), разновидность генеративной стохастической нейронной сети, которая определяет распределение вероятности на входных образцах данных. В настоящее время RBM модифицирована согласно изобретению Джеффри Хинтона (Jeoffrey Hinton) быстрых алгоритмов обучения в середине 2000-х годов.

1990-е

- В 1990 г. в статье «Сила слабого обучения» (The Strength of Weak Learnability) (http://rob.schapire.net/papers/strengthofweak.pdf) учёного из Массачусетского Технологического Института (MIT) Роберта Шапире (Robert E. Schapire) был представлен алгоритм усиления (boosting algorithm) машинного обучения. Алгоритм усиления увеличивает предсказательною возможность моделей искусственного интеллекта.

- В 1997 г. специалисты из компании Interval Research Кристоф Бреглер (Cristoph Bregler), Мишель Ковелл (Michele Covell) и Малькольм Слани (Malcolm Slaney) разработали первую в мире программу “deepfake” (https://www.isca-archive.org/avsp_1997/bregler97_avsp.pdf), которая могла синтезировать артикуляцию по исходному тексту и фотографии говорящего.

- В 1997 г. знаменитая шахматная программа Deep Blue смогла выиграть у одного из лучших шахматистов в истории Гарри Каспарова (в 2022 г. Минюст России внес Гарри Каспарова в реестр «иностранных агентов»).

2000-е

- В 2009 г. профессор компьютерных наук в Стэнфордском университете по имени Фей-Фей Ли (Fei-Fei Li) запустила ImageNet, наиболее обширную библиотеку маркированных изображений, которая была предназначена для разнообразного обучения ИИ и МЛ по моделям изображений из реальной жизни. Журнал The Economist назвал появление ImageNet выдающимся событием для популяризации ИИ в техническом сообществе и шагом вперед к новой эре в развитии методов глубокого обучения.

- В 2011 г. Команда X Lab компании Google разработала алгоритм ИИ для обработки изображений Google Brain, который был способен распознавать кошек на изображении.

2014 г.

- Американский учёный-компьютерщик Ян Гудфеллоу (Ian J. Goodfellow) с коллегами разработал концепцию генеративных состязательных сетей GAN (Generative Adversarial Networks), которые позволяли моделям ИИ генерировать совершенно новые данные из их заданных наборов данных для обучения.

- Команда исследователей компании Faсebook разработала программу DeepFace, которая может распознавать человеческие лица на изображении с точностью 97,35%. Это нейросеть с девятью слоями. Сеть была обучена на более чем4 млн изображений пользователей Faсebook.

- Google начала использовать систему Sybil для прогнозирования успешности их продуктов. Sybil является платформой машинного обучения на широкой базе, которая использовала много новых алгоритмов, работающих вместе. Она существенно улучшила производительность при помощи параллельного усиления. Кроме того, использует поведение пользователей для ранжирования продуктов и рекламы.

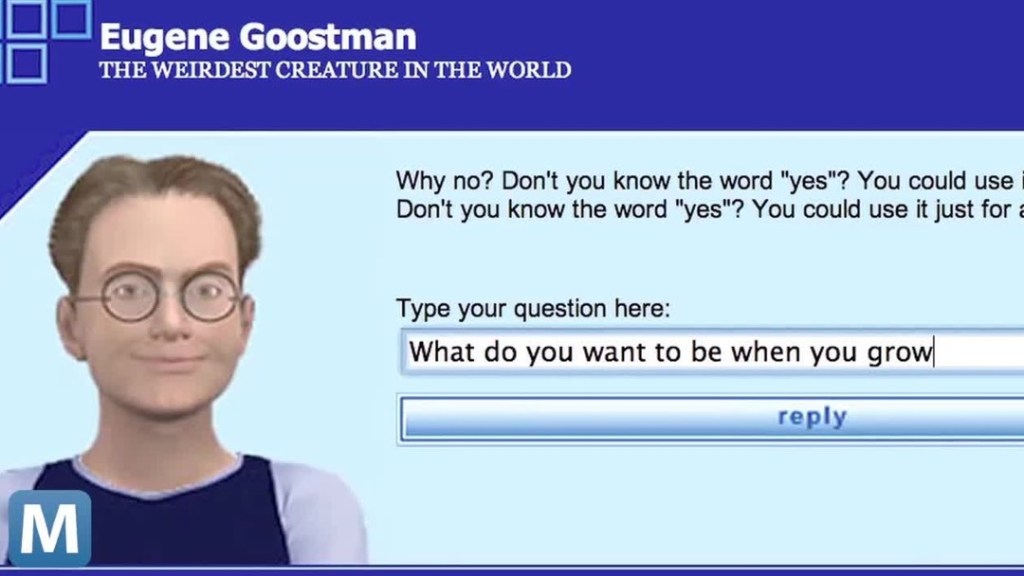

- Группа из трёх программистов: Владимира Веселова (родом из России, живёт в Нью-Джерси), Евгения Демченко (родом из Украины) и Сергея Уласеня (родом из России) разработали программу виртуального собеседника под названием «Женя Густман» (Eugene Goostman). Разработка программы была начата в Санкт-Петербурге в 2001 году. Она является первым чат-ботом, имитирующим реального собеседника. Чтобы характер и знания Жени Густмана казались более правдоподобными, он представляется пользователям 13-летним мальчиком из Одессы. Эта программа прошла тест Тьюринга 7 июня 2014 г.

- В 2015 г. первая программа ИИ под названием «AlphaGo» впервые победила профессионального игрока сложной японской игры Го. Эта игра считается принципиально неспособной для обучения компьютера игры в неё.

- В 2016 г. группа учёных представила программу Face2Face на конференции по компьютерному зрения и распознаванию образов. Большинство программ “Deepfake”, используемых в настоящее время, основаны на логике и алгоритмах Face2Face.

2017 г.

- Компания Waymo (США) представила технологии для беспилотных автомобилей.

- Была опубликована статьа Attention Is All You Need (https://arxiv.org/abs/1706.03762) , в которой была представлена архитектура Transformer, основанная на механизме «само-внимания (self-attention), которая позволила достичь существенного прогресса в машинном распознавании естественной речи.

- В 2021 г. Филиал компании Google DeepMind AlphaFold 2 победил в соревновании «CASP13 protein folding competition» по предсказанию структуры протеина в категории свободного моделирования FM (Free Modelling), что явилось значительным усовершенствованием в предсказании структуры протеина на основе глубокого обучения (deep learning).

- В 2022 г. платформа OpenAI компании Google революционизировала большие языковые модели, приспособив их для массового использования. Различные приложения машинного обучения на базе этой платформе используют эту платформу в повседневной жизни.

2023 г.

- Программа ChatGPT, которая была запущена годом ранее, стала массово использоваться в повседневной жизни.

- В марте 2023 г. на платформе OpenAI компании Google была запущена новая версия GPT-4

- Компания Microsoft представила платформу Bing Chat, затем преобразованную в Copilot, которая широко использует ИИ AI и ввела его в облачную платформу Microsoft 365 Copilot.

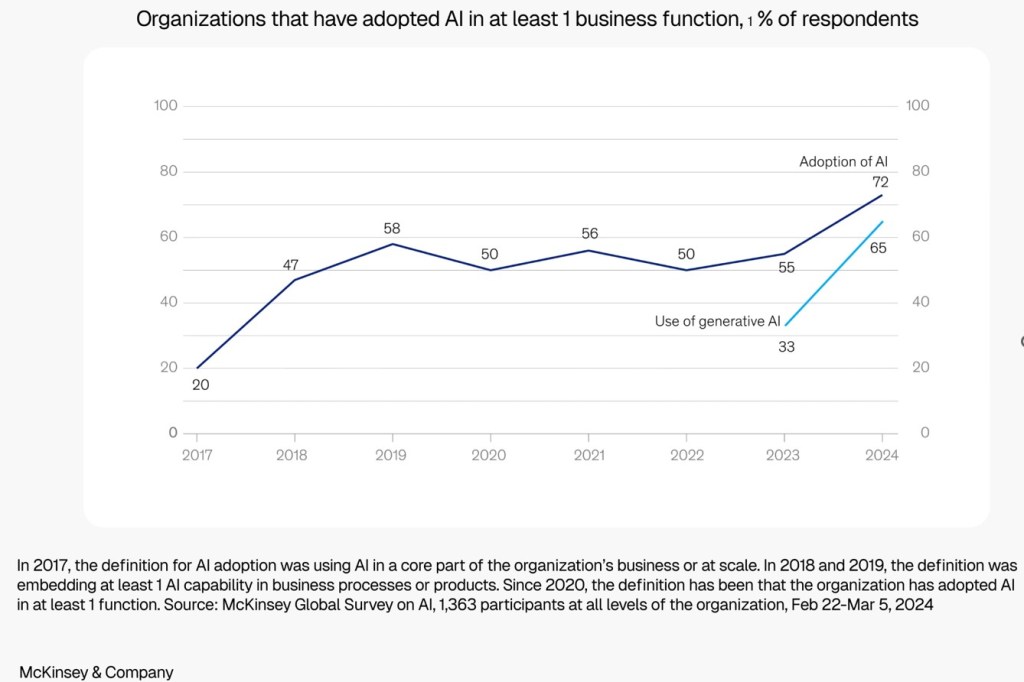

- 2024 г. был опубликован отчет консультационной компании McKinsey & Company (https://www.mckinsey.com/capabilities/quantumblack/our-insights/the-state-of-ai#/), где отмечалось, что 2024 год станет важным поворотным моментом во внедрении искусственного интеллекта (ИИ), в частности генеративного ИИ (generative AI), работающего на основе базовых моделей. В отчёте отмечается, что все больше организация используют технологии ИИ, причем использование генеративного ИИ растёт опережающими темпами.